Datenanalyse einfach erklärt

Dieser Beitrag führt in die Datenanalyse ein und zeigt auf, warum sie der Schlüssel für bessere Entscheidungen ist. Egal ob man Student ist, ein Unternehmen führt, forscht oder einfach nur mehr über seine eigenen Daten erfahren möchte – die Fähigkeit, Daten zu analysieren, ist ein extrem nützliches Werkzeug für jede Person die weiß, wie “Datenanalyse” funktioniert. Also auf geht’s!

Überblick

1. Was ist Datenanalyse

2. Warum ist Datenanalyse wichtig?

3. Die Schritte der Datenanalyse

4. Welche Datenanalyse-Tools gibt es?

5. Methoden der Datenanalyse

6. Fazit

Was ist Datenanalyse?

Eine Definition:

Datenanalyse ist der Prozess, große Datenmengen zu

- sammeln,

- organisieren und

- interpretieren,

um nützliche Informationen zu gewinnen. Man zielt darauf ab, Muster, Trends und Zusammenhänge zu erkennen, um auf deren Grundlage fundierte Entscheidungen zu treffen - wie genau wird im nächsten Absatz deutlich.

Warum ist Datenanalyse wichtig?

Besonders bedeutend ist die Datenanalyse aufgrund ihrer Fähigkeit, Einblicke zu liefern, die zu besseren Entscheidungen führen. Beispiele hierfür sind:

-

Unternehmensentscheidungen: Unternehmen nutzen Datenanalyse, um Verkaufszahlen zu überwachen, Markttrends zu verstehen und Kundenpräferenzen zu identifizieren. Dies hilft ihnen, ihre Geschäftsstrategien zu optimieren und sich einen Wettbewerbsvorteil zu verschaffen. Durch Datenanalyse beantworten sie z.B. folgende Fragen:

-

Lohnt es sich, in Indien ein Werk zu eröffnen? Dazu werden Daten über Produktionskosten sowie die Entwicklung der Löhne hinzugezogen, aber auch demographische Daten zur Altersstruktur der Bevölkerung sowie des Konsumverhaltens. All diese Daten müssen analysiert und sinnvoll verbunden werden.

-

Wie entwickelt sich der Lagerbestand eines bestimmten Produktes in einer Region? Geht die Nachfrage zurück? Sollen wir die Produktion drosseln oder handelt es sich dabei möglicherweise um eine saisonale Besonderheit?

-

-

Risikobewertung: Finanzdienstleistungsunternehmen verwenden Datenanalyse mit unterschiedlichem Fokus:

-

Banken analysieren Kreditnehmerdaten und schätzen auf ihrer Basis das Risiko eines Kreditausfalls ein. Dazu analysieren sie bspw. in welchen Einkommensschichten oder Altersklassen im Zusammenhang mit dem Wohnort oder anderen Merkmalen die Kreditverpflichtungen (in der Regel Ratenzahlungen) nicht erfüllt werden.

-

Versicherungsunternehmen führen beispielsweise in der Kfz-Versicherungssparte Datenanalyse durch, um auf dieser Basis zu ermitteln, bei welcher Automarke mit welcher Motorisierung die häufigsten Unfälle passieren. Dabei verbinden die Versicherer viele Datenpunkte und Merkmale - wie zum Beispiel Fahrerfahrung der Halterperson, Geschlecht, Alter - und schätzen so die Schadenswahrscheinlichkeiten und Schadenhöhen ein. Auf dieser Grundlage können Tarife berechnet werden.

-

-

Optimierung im Marketing: Mit Hilfe der Datenanalyse können Marketingexperten herausfinden, welche Kampagnen erfolgreich sind und welche nicht, um ihre Budgets effektiver einzusetzen. Sie beantworten Fragen wie zum Beispiel: Über welche Plattformen werden die meisten Käufe getätigt und spiegelt die Verteilung der Anzeigenkosten die Umsatzverteilung wider? Die grobe Fragestellung für eine Analyse könnte wie folgt aussehen:

- Wir geben täglich 50 EUR für Anzeigen auf Instagram aus und erwirtschaften einen Umsatz in Höhe von 100 EUR. Zugleich geben wir auf Youtube nur 40 EUR aus, erzielen damit aber einen Umsatz in Höhe von 120 EUR. Frage: Macht es Sinn, das Budget von Instagram auf Youtube umzuverteilen? Wann ja, in welcher Höhe und zu welchen Uhrzeiten? Antwort: “Ohne Datenanalyse wird das nichts.”

-

Risikobewertung: Auch auf persönlicher Ebene kann Datenanalyse helfen.

-

Fitness-Apps analysieren beispielsweise deine Gesundheitsdaten, um personalisierte Trainingspläne zu erstellen. Du kannst sämtliche Kalorien tracken und messen, ob du mit deinem gegenwärtigen Essverhalten übergewichtig wirst, wenn du keinen Sport als Ausgleich treibst. Du könntest dich fragen: Welche Sportart verbrennt die meisten Kalorien und wie viel mehr kann ich essen, ohne zuzunehmen, wenn ich Sport treibe?

-

Du kannst deine Kontodaten als .csv-Datei herunterladen und die Kontobewegungen analysieren. Wieviel gebe ich im Monat für Abos aus? Liegen meine Einnahmen über den Ausgaben? Wo könnte ich sparen und was kann ich mir diesen Monat leisten?

-

Die Schritte der Datenanalyse

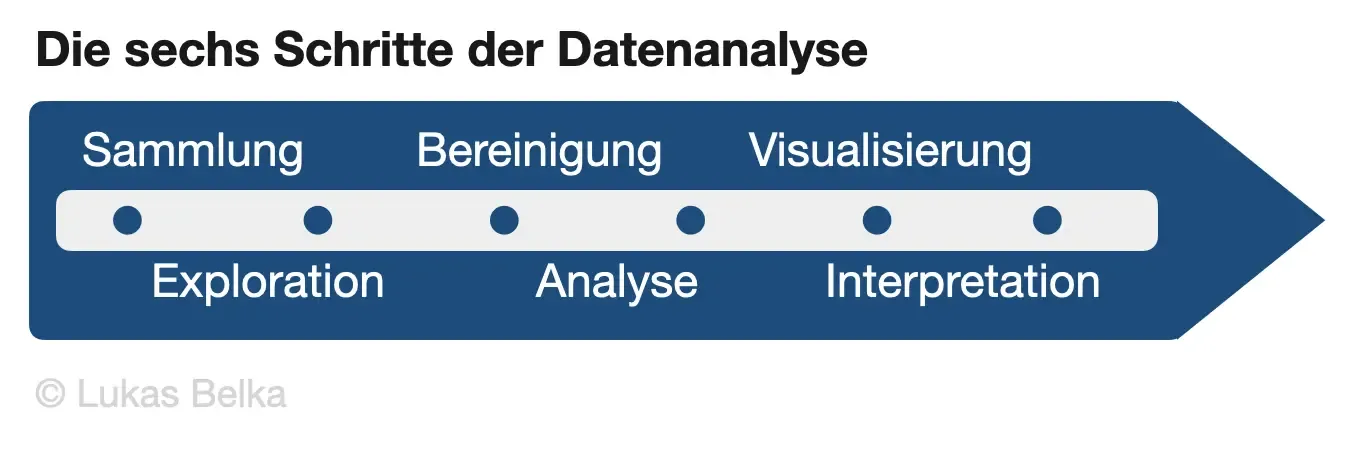

Für eine erfolgversprechende Datenanalyse sind mehrere Schritte zu befolgen. Der oben gezeigte, in drei Schritte aufgeteilte Prozess setzt voraus, dass die Daten bereits relativ “sauber” vorliegen, sodass deren Auswertung ohne weitere Schritte unverzüglich möglich ist. Man ahnt es schon: Dies ist so gut wie niemals der Fall! Diverse Quellen berichten darüber, dass die Datenbereinigung im Schnitt 80% der gesamten Zeit ausmacht, die ein Data Analyst oder Data Scientist aufbringen muss, bevor er Daten interpretieren kann. Seit Jahren ist Datenbereinigung daher ein wichtiges Thema[1], sodass der Prozess der Datenanalyse im Folgenden verfeinert dargestellt ist.

- Datensammlung: Im ersten Schritt sammelt man relevante Daten, entweder manuell per Download oder beispielsweise automatisiert über Schnittstellen (sogenannte APIs - Application Programming Interfaces). Dabei können die Datenquellen interner oder externer Art sein:

-

Interne Datenquellen: Dies sind in der Regel Datenbanken, welche ihre Daten dadurch erhalten, dass die Nutzer in einer Software (z.B. Programm für Lagerhaltung) auf “speichern” klicken. Dieser Klick auf den Button schreibt einen Datensatz in die Datenbank - es handelt sich um intern generierte Daten, die auf internen Datenbanken gespeichert werden.

-

Externe Datenquellen: Diese können sich in Art oder Inhalt unterscheiden. Zum einen gibt es Cloud-Anbieter, welche die Speicherung und Verarbeitung von Daten anbieten. Zum anderen existieren Datenanbieter, wie z.B. die Europäische Zentralbank, über deren Website man unter anderem Wechselkurse als .csv-Datei herunterladen kann - von einer externen Datenbank (Datenquelle).

-

Initiale Datenexploration: In diesem Schritt werden die gesammelten Daten validiert. Der Aufwand für die initiale Datenexploration hängt dabei im Wesentlichen von der Datenquelle ab. Interne Datenquellen halten die Daten meist sauber vor und stellen diese im benötigten Format zur Verfügung, um sicherzustellen, dass keine Fehler und Inkonsistenzen vorliegen.

-

Datenbereinigung: Dieser Schritt hängt wiederum vom Resultat der initialen Datenexploration ab und bringt mehr Aufwand mit sich, wenn die Daten von externen Quellen bezogen werden oder nicht “vorbehandelt” sind. Man nennt diese Art von Daten auch Rohdaten. Sie liegen oft unvollständig oder unstrukturiert vor und müssen daher während der Datenbereinigung aufbereitet werden, indem Fehler korrigiert und fehlende Werte ergänzt oder entfernt werden.

-

Datenanalyse: In diesem Schritt werden statistische Methoden und Softwaretools wie Excel, Python, oder spezielle Analyseplattformen (z.B. Tableau oder Power BI) verwendet, um Muster zu erkennen und Fragen zu beantworten. Weiter unten enthalten zwei Listen jeweils eine Aufzählung der Analysemethoden als auch die derzeit meistgefragten Tools.

-

Datenvisualisierung: Eine gute Visualisierung ist entscheidend, um komplexe Daten verständlich zu präsentieren. Diagramme, Grafiken und Dashboards helfen dabei, Ergebnisse klar zu kommunizieren. In diesem Schritt kann man entweder auf dedizierte Software zurückgreifen oder Bibliotheken der relevanten Programmiersprachen verwenden (wie im nächsten Punkt genannt).

-

Interpretation und Schlussfolgerung: Die visualisierten Daten können in diesem Schritt schließlich analysiert und interpretiert werden. Die gewonnenen Erkenntnisse dienen als Grundlage für Entscheidungen oder die Entwicklung neuer Strategien.

Welche Datenanalysetools gibt es?

Es gibt zahlreiche Werkzeuge für die Datenanalyse und ebenso vielfältig ist die Nutzerbasis. Vor allem kleine und mittelständische Unternehmen (KMU) arbeiten an ihren Data Analytics-Fähigkeiten und stehen vor der Herausforderung des Fachkräftemangels und der Kosten, die mit dem Ökosystem für Datenanalyse einhergehen. Große Konzerne haben bereits Geldmittel investieren können, um in der Cloud ein professionelles Data-Stack zu betreiben und zugleich die Data-Teams aufzubauen - dementsprechend unterschiedliche Werkzeuge werden eingesetzt.

Während Einsteiger häufig in Excel unterwegs sind, nutzen Data Analysts und Data Scientists meist eine der beiden üblichen Programmiersprachen (Python oder R) und setzen für die Datenvisualisierung entsprechende Bibliotheken ein.

Software für die Datenanalyse

- Microsoft Excel

- Microsoft PowerPivot (PlugIn für Excel)

Excel. Zurecht nennt man es auch “Das Allerwelts-Tool”. Kein Wunder: Für viele ist Excel das Standardwerkzeug für die Datenanalyse und keiner kommt an dessen Tabellen, Tabs und Spalten mehr vorbei. Es eignet sich hervorragend für einfache und schnelle Analysen - mal eben fix eine Pivot-Tabelle erstellen oder ein Diagramm einbetten, kein Problem!

Einen Schritt weiter geht Microsoft’s Pover Pivot-Plugin für Excel. Dieses erlaubt die Anbindung unterschiedlicher Datenquellen und auch das Auslesen von Tabellen, die in .pdf-Dokumente eingebettet liegen. Es ist möglich, jede Tabelle separat auszulesen und die Daten anschließend im Power Query Editor nach Gusto zu transformieren. In diesem Zusammenspiel bietet Microsoft’s “Datensuite” beachtliche Möglichkeiten.

Programmiersprachen für die Datenanalyse

- Python

- R

- SQL (Structured Query Language ist eine Datenbank-Sprache)

Python ist ein Alleskönner! Ob Webentwicklung, Schnittstellenprogrammierung oder Maschinelles Lernen - es gibt eine schier ungeheure Anzahl an Bibliotheken für diverse Zwecke. Dennoch ist Python “die Programmiersprache” in Sachen Daten und erfreut sich zurecht großer Beliebtheit, insbesondere bei Datenanalysten, Data Scientists oder Data Engineers.

Wer extrahiert, lädt und transformiert, nutzt in der Regel eine der vielen Bibliotheken. Dabei spielen auch die großen amerikanischen Unternehmen mit. So hat Google für das Deep Learning mit neuronalen Netzen “Tensorflow” herausgebracht und entwickelt dieses stetig weiter. Facebook’s Mutterkonzern Meta wiederum entwickelte Pytorch - ebenfalls eine Bibliothek für Deep Learning. Das verdeutlicht: Python’s Anwendung geht weit über das reine Extrahieren, Laden und Transformieren hinaus.

Im Schatten von Python benutzen Anwender auch die Programmiersprache R. Ursprünglich stammen ihre User aber eher aus mathematisch-statistischen Domänen. Auch für R werden laufend Bibliotheken (weiter-)entwickelt, allerdings ist die Anwendungsbreite hier geringer als bei Python. Beide Programmiersprachen bringen jeweils tolle Bibliotheken für die Datenanalyse mit, die komplexe Untersuchungen erlauben und anschauliche Visualisierungen erstellen.

SQL - Structured Query Language ist die Dritte im Bunde. Sie ist keine echte Programmiersprache, sondern eine Datenbanksprache, die es ermöglicht, Daten in einer Datenbank zu verwalten und abzurufen. Mittels SQL sucht man Daten, fügt welche hinzu, bearbeitet sie oder löscht sie. SQL wird häufig in relationalen Datenbanken verwendet - was das ist, klären wir an anderer Stelle. Die in den Tabellen gespeicherten Informationen können jeden Bezug aufweisen - z.B. Kundenlisten, Produktinformationen oder Bestellungen.

Die wichtigsten Befehle in SQL sind:

- SELECT zum Abrufen von Daten

- INSERT zum Ein-/Hinzufügen neuer Daten

- UPDATE zum Ändern vorhandener Daten

- DELETE zum Löschen

Durch diese Befehle ermöglicht SQL eine effiziente und strukturierte Datenverwaltung, was in vielen Unternehmen und Anwendungen unverzichtbar ist.

Business Intelligence Tools für die Datenanalyse

BI-Tools:

- Tableau

- PowerBI

- Apache Superset

- QLink

- Google Looker/Data Studio

Business Intelligence-Tools ermöglichen im Vergleich zu Python und R eine vergleichsweise einfache Datenvisualisierung, denn anstatt dass der User Programmiercode schreibt, kann er per Drag-and-Drop Visuals auf ein Canvas ziehen und so interaktive Dashboards aufbauen, die in Echtzeit aktualisiert werden können. Ebenso wie die zu bewältigenden Datenmengen stetig ansteigen, steigt auch die Nachfrage öffentlicher und privater Akteure nach BI-Tools - das lockt immer mehr Anbieter ins Feld.

Das IT Forschungs- und Beratungsunternehmen Gartner veröffentlicht regelmäßig seinen sogenannten “magischen Quadranten” für diverse Branchen. Darunter befindet sich auch der unten gezeigte magische Quadrant für Analytics und Business Intelligence Plattformen, der Gartner’s Einschätzung darüber aufzeigt, welche Unternehme mit ihren Produkten im Markt führen, welche Firmen sie herausfordern, wer in einer Nische aktiv ist und wer als Visionär gilt.

Methoden der Datenanalyse

Wer sucht, der findet im Kontext der Datenanalyse viele Methoden, die entweder auf qualitative oder quantitative Aspekte der Daten eingehen und Aussagen erlauben. Eine abschließende Aufzählung ergibt keinen Sinn, sodass der folgende Abschnitt nur die häufigsten Methoden aus der Praxis behandelt.

-

Deskriptive Analyse: Die Deskriptive Analyse ist meistens der erste Schritt der Datenanalyse. Hierbei zieht man vorhandene, vergangenheitsbezogene Daten durch den statistischen Fleischwolf und ermittelt standardisierte Kennzahlen wie den Mittelwert, Median, Modus oder die Standardabweichung. Denkbar ist auch der Einsatz unkomplizierter Visualisierungen oder Tabellen, um einen ersten Eindruck zu gewinnen - Ziel der deskriptiven Analyse ist das Erkennen grundlegender Muster, zentraler Tendenzen oder Streuungen sowie Zusammenhängen.

Das Ergebnis einer deskriptiven Analyse ist weder eine Schlussfolgerung noch eine Vorhersage, sondern eine schlichte Basis für das bessere Verständnis der Daten. Möglicherweise lassen sich potenzielle Hypothesen entwickeln, die weitergehende Analysen ermöglichen.

-

Prädiktive Analyse: Im Gegensatz zur deskriptiven Analyse, die sich auf die Beschreibung von Daten konzentriert, geht die prädiktive Analyse einen Schritt weiter. Sie zielt darauf ab, zukünftige Ereignisse oder Trends auf Basis historischer Daten vorherzusagen und nutzt dafür statistische Modelle, maschinelles Lernen und Algorithmen. Es geht nicht ausschließlich um die Erkennung von Mustern in den Daten, sondern vor allem um die Ableitung von Prognosen für die Zukunft. Ziel ist es, fundierte Entscheidungen zu treffen, indem man weiß, was in der Zukunft wahrscheinlich passieren könnte.

Da die prädiktive Analyse Vorhersagen über mögliche zukünftige Entwicklungen trifft, wird sie in vielen Bereichen eingesetzt, zum Beispiel um Kundenverhalten zu prognostizieren, Markttrends zu erkennen oder Risiken einzuschätzen.

-

Präskriptive Analyse: Präskriptive Analyse ist ein fortgeschrittener Bereich der Datenanalyse, der darauf abzielt, konkrete Handlungsempfehlungen für zukünftige Entscheidungen zu geben. Im Gegensatz zur deskriptiven Analyse (die Daten beschreibt) und zur prädiktiven Analyse (die Vorhersagen trifft), zeigt die präskriptive Analyse optimale Wege auf, um ein gewünschtes Ergebnis zu erzielen. Sie verwendet dabei komplexe Algorithmen, Simulationen und maschinelles Lernen, um nicht nur zu sagen, was passieren könnte, sondern auch, was getan werden sollte.

Beispielsweise hilft sie Unternehmen dabei, die besten Maßnahmen für Kosteneinsparungen, Produktionsoptimierung oder Marketingstrategien zu identifizieren. Ziel ist es, nicht nur zu verstehen und vorherzusagen, sondern auch konkrete, datenbasierte Empfehlungen zur Entscheidungsfindung zu liefern.

-

Zeitreihenanalyse: Die Zeitreihenanalyse ist ein Bereich der Datenanalyse, der sich mit Daten beschäftigt, die über einen bestimmten Zeitraum hinweg gesammelt wurden. Beispiele für Zeitreihen sind tägliche Aktienkurse, monatliche Verkaufszahlen oder jährliche Temperaturen. Hier sollen Muster, Trends und saisonale Schwankungen in den Daten erkannt und verstanden werden.

Die Analyse solcher Daten ermöglicht es, historische Entwicklungen zu betrachten und Vorhersagen für zukünftige Zeitpunkte zu treffen. Dabei werden spezielle statistische Methoden und Modelle eingesetzt, um Zusammenhänge über die Zeit zu erkennen. Die Zeitreihenanalyse findet Anwendung in vielen Bereichen, wie z. B. Wirtschaft, Wettervorhersage oder Gesundheitswesen, und hilft dabei, fundierte Entscheidungen auf Basis vergangener Daten zu treffen.

-

Regressionsanalyse: Die Regressionsanalyse untersucht den Zusammenhang zwischen Variablen und hilft dabei zu verstehen, wie eine oder mehrere unabhängige Variablen (z. B. Alter, Einkommen) eine abhängige Variable (z. B. Ausgaben) beeinflussen. Durch die Anwendung von mathematischen Modellen, wie der linearen Regression, kann man vorhersagen, wie sich die abhängige Variable ändert, wenn sich die unabhängigen Variablen verändern. Als eine Art der Datenanalyse hilft die Regressionsanalyse dabei, Trends, Korrelationen und Kausalitäten in den Daten zu erkennen und Prognosen zu treffen. Sie wird in vielen Bereichen genutzt, etwa in der Wirtschaftsforschung, dem Marketing oder der Medizin, um Zusammenhänge aufzudecken und datenbasierte Entscheidungen zu unterstützen.

Neben den genannten Analysen finden sich noch weitere, die lediglich stichwortartig aufgezählt werden:

- Diagnostische Analyse

- Cluster Analyse

- Faktoranalyse

- Kohortenanalyse

Fazit

Eines wird deutlich: Die Datenanalyse ist ein mächtiges Instrument und ist essentiell, um aus großen Datenmengen wertvolle Informationen zu gewinnen. Ob im Geschäftsleben, im Marketing oder im persönlichen Bereich: Wer in der Lage ist, Daten richtig zu analysieren, kann datenbasierte und somit häufig bessere Entscheidungen treffen und schließlich erfolgreicher agieren – mit den richtigen Werkzeugen und Methoden wird Datenanalyse zu einem unverzichtbaren Bestandteil in Data Analytics.